Articles récents

Agence SEO Villeurbanne : dominez votre marché local

Stratégie proactive e-réputation : maîtriser la GEO

Besoin d'un audit SEO gratuit ?

Découvrez les opportunités cachées de votre site. Notre équipe analyse vos données et vous propose une stratégie sur mesure.

Robots.txt : contrôler ce que Google voit sur votre site

Le fichier robots.txt est le premier document que les robots des moteurs de recherche consultent en arrivant sur votre site. Ce simple fichier texte, place à la racine de votre domaine, définit les règles d’exploration de votre site par les crawlers. Mal configure, il peut rendre votre site invisible sur Google.

Comment fonctionne le robots.txt

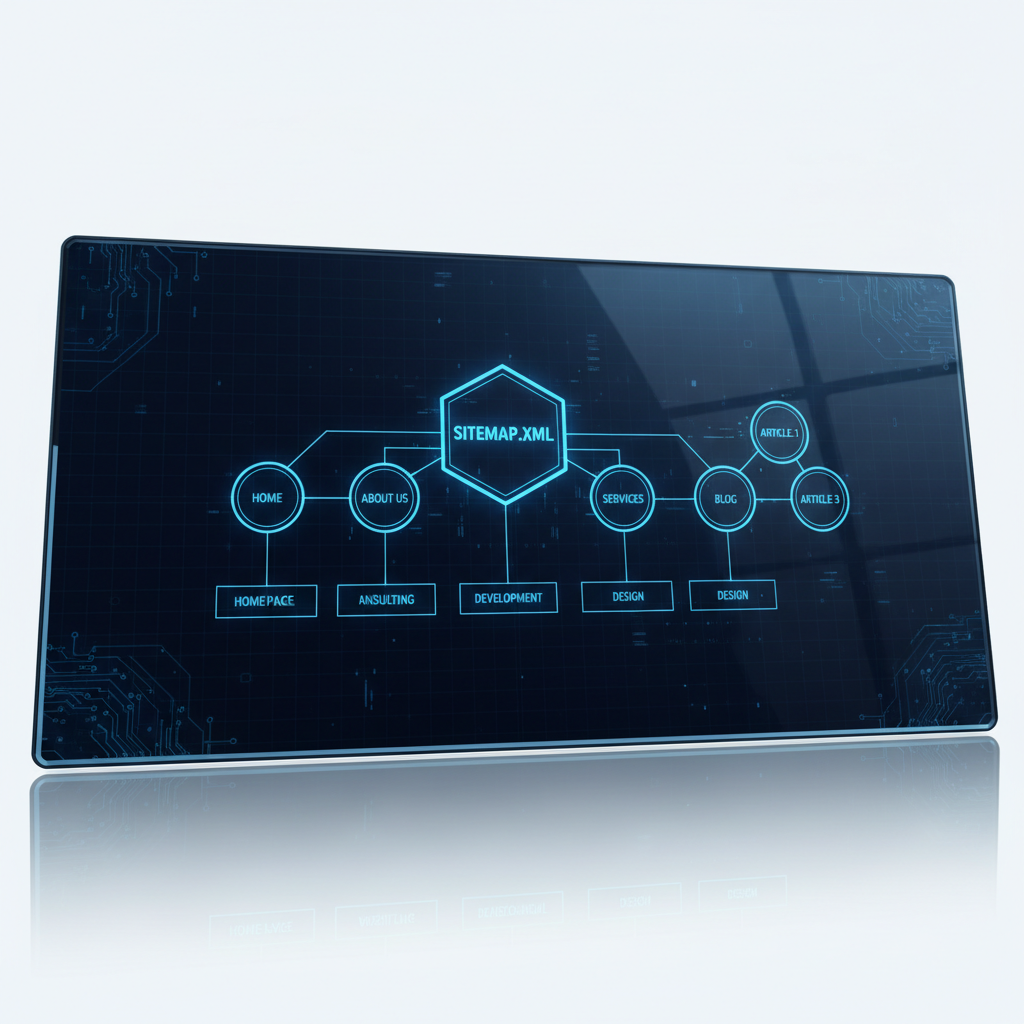

Le robots.txt utilise des directives simples. « User-agent » désigné le robot concerne (Googlebot, Bingbot, ou * pour tous). « Disallow » bloque l’accès à un chemin. « Allow » autorise l’accès à un chemin spécifique au sein d’un repertoire bloque. « Sitemap » indique l’emplacement de votre plan de site.

Google respecte les directives du robots.txt mais ne les considère pas comme une méthode de sécurité. Si vous bloquez une page dans le robots.txt mais que d’autres sites la lient, Google peut quand meme l’afficher dans les résultats (sans contenu). Pour vraiment empêcher l’indexation, utilisez la balise meta noindex.

Le fichier doit être accessible à l’URL exacte votredomaine.com/robots.txt. S’il est absent, Google considère que tout le site est explorable. S’il retourne une erreur serveur (5xx), Google peut temporairement arreter l’exploration de tout le site par precaution.

Ce qu’il faut bloquer et ce qu’il ne faut pas

Bloquez les zones sans intérêt SEO : le back-office WordPress (/wp-admin/), les résultats de recherche interne, les pages de panier et de compte, les filtres a facettes qui génèrent des URLs dupliquées. Ces sections gaspillent le crawl budget sans apporter de valeur.

Ne bloquez jamais vos fichiers CSS et JavaScript. Google a besoin de les charger pour rendre vos pages comme un navigateur et évaluer l’expérience utilisateur. Bloquer ces ressources degrade vos Core Web Vitals aux yeux de Google.

Ne bloquez pas non plus vos images où vos videos si vous souhaitez qu’elles apparaissent dans Google Images ou Google Videos. Et ne bloquez jamais vos pages de contenu principal par erreur. Une ligne Disallow mal placée peut désindexer des sections entières de votre site.

Besoin d’un coup de boost pour votre SEO ?

Tester et valider votre fichier

Google Search Console propose un outil de test du robots.txt. Entrez une URL et il vous dira si elle est bloquée ou autorisée. Testez systematiquement vos pages importantes après chaque modification du fichier.

Verifiez aussi que votre fichier ne contient pas d’erreurs de syntaxe. Un espace où un caractère special mal place peut changer complètement le comportement. La directive « Disallow: / » bloque tout le site, tandis que « Disallow: » (vide) n’à aucun effet.

Pour les sites WordPress, Rank Math et d’autres plugins SEO permettent d’éditer le robots.txt directement depuis l’interface d’administration. C’est plus pratique que l’édition FTP et réduit les risques d’erreur. Contactez notre équipe pour un audit technique de votre configuration.

Questions frequentes

Le robots.txt empêche-t-il l’indexation d’une page ?

Non. Le robots.txt empêche l’exploration, pas l’indexation. Si une page bloquée dans le robots.txt reçoit des liens externes, Google peut l’indexer sans la visiter, en affichant juste l’URL sans description. Pour empêcher l’indexation, utilisez la balise meta noindex.

Que se passe-t-il si je supprime le fichier robots.txt ?

Google considère que tout le site est accessible et explorable. Ce n’est pas problematique en soi, mais vous perdez le contrôle sur les zones que Google explore, ce qui peut gaspiller du crawl budget sur des pages inutiles.

Faut-il bloquer les bots d’IA comme GPTBot dans le robots.txt ?

C’est un choix stratégique. Bloquer GPTBot ou Claude empêche ces IA d’utiliser votre contenu pour entraîner leurs modèles. Mais cela peut aussi vous rendre invisible dans les réponses générées par ces IA. Évaluez le compromis selon votre stratégie.

Karim B.

Fondateur de Rankit · Agence SEO Lyon

Passionné par les données et le référencement depuis plus de 5 ans, j’accompagne les entreprises locales et e-commerce dans leur croissance organique. Mon approche : zéro bullshit, que du mesurable. Chaque stratégie que je déploie est pilotée par la Search Console, testée sur le terrain et optimisée pour des résultats concrets.