Articles récents

Besoin d'un audit SEO gratuit ?

Découvrez les opportunités cachées de votre site. Notre équipe analyse vos données et vous propose une stratégie sur mesure.

Crawl budget : comment Google explore votre site et pourquoi cela compte

Le crawl budget détermine combien de pages Google va explorer sur votre site lors de chaque visite de ses robots. Comprendre ce concept est essentiel pour toute entreprise qui veut que l’ensemble de son contenu soit indexe et visible dans les résultats de recherche.

Qu’est-ce que le crawl budget exactement

Le crawl budget est la combinaison de deux facteurs : la capacité de crawl (le nombre de requêtes que Googlebot peut faire sans surcharger votre serveur) et la demande de crawl (l’intérêt de Google pour votre contenu). Google ne va pas explorer des millions de pages sur un site qui n’en mérite pas autant.

Pour les petits sites (moins de 1 000 pages), le crawl budget est rarement un problème. Google a largement les ressources pour tout explorer. Le sujet devient critique pour les sites e-commerce avec des milliers de fiches produit, les sites d’annonces, où les plateformes avec du contenu génère dynamiquement.

Googlebot priorise les pages qu’il juge importantes : celles avec beaucoup de liens internes, celles mises à jour récemment, et celles qui génèrent du trafic. Les pages profondes, rarement liées et jamais modifiées, passent en dernier et parfois ne sont jamais explorées.

Les facteurs qui gaspillent votre crawl budget

Les pages dupliquées sont le premier gaspillage. Les variantes d’URL (avec et sans www, avec et sans slash final, parametres de tri ou filtrage) multiplient les pages a explorer sans ajouter de valeur. Configurez des canonicals et des redirections pour éliminer les doublons.

Les pages de faible qualité gaspillent aussi du budget : pages de tag vides, résultats de recherche internes indexables, anciennes pages 404 non redirigées. Chaque fois que Googlebot explore une page inutile, c’est une page utile qui n’est pas explorée.

Les erreurs serveur (5xx) et les temps de réponse trop longs degradent directement la capacité de crawl. Si votre serveur met 3 secondes a répondre au lieu de 200 millisecondes, Googlebot ralentit automatiquement pour ne pas le surcharger, explorant 15 fois moins de pages.

Besoin d’un coup de boost pour votre SEO ?

Optimiser l’exploration de votre site

Le fichier robots.txt est votre premier outil de contrôle. Bloquez les sections que Google n’a pas besoin d’explorer : back-office, pages de recherche interne, filtres a facettes. Attention : ne bloquez jamais vos pages de contenu principal où vos ressources CSS/JS nécessaires au rendu.

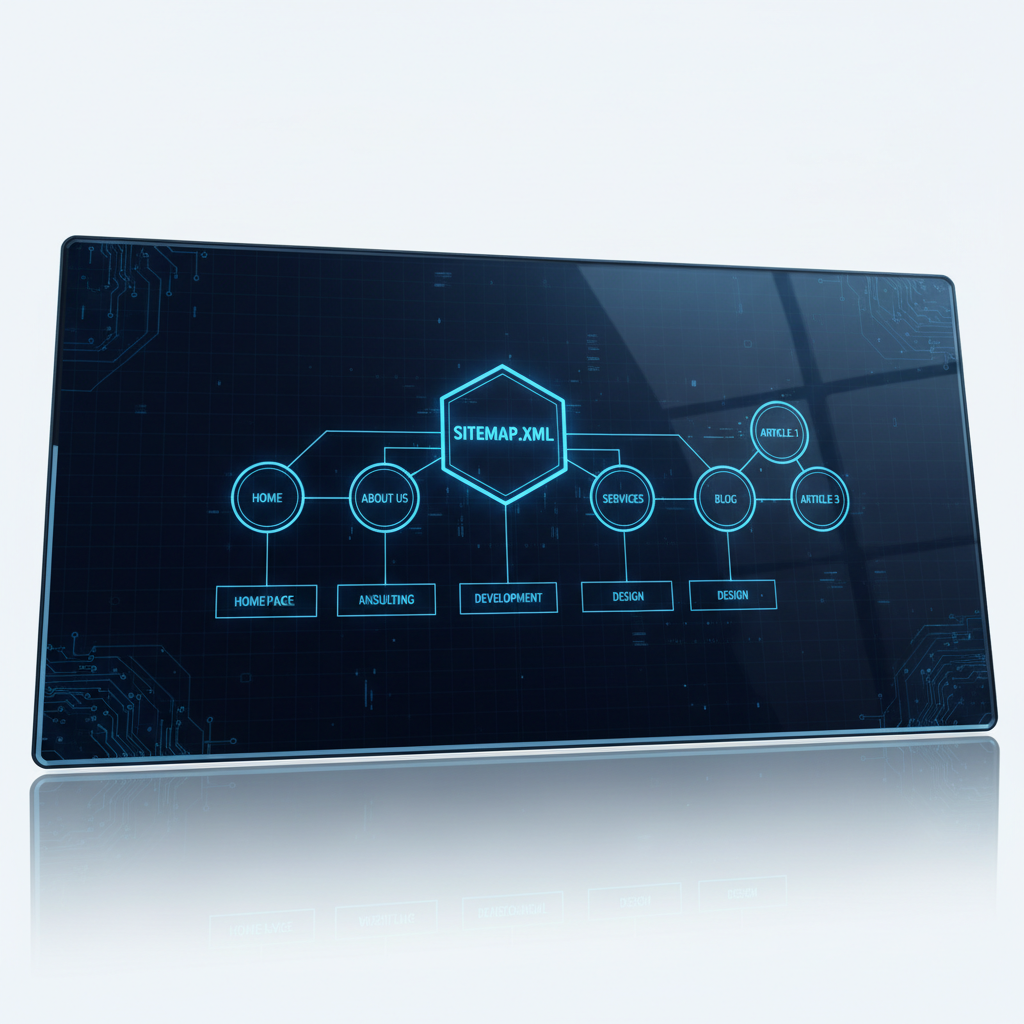

Votre sitemap XML guide Googlebot vers vos pages prioritaires. Incluez uniquement les pages canoniques, indexables, et de bonne qualité. Mettez à jour le sitemap à chaque modification pour signaler les changements. Soumettez-le dans Google Search Console.

L’architecture de votre site influence directement le crawl. Une structure plate où chaque page est accessible en 3 clics maximum facilité l’exploration. Un expert SEO à Lyon peut auditer votre architecture et identifier les pages orphelines inaccessibles aux robots.

Surveiller et diagnostiquer les problèmes de crawl

Le rapport de statistiques d’exploration dans Google Search Console montre le nombre de requêtes par jour, le temps de réponse moyen, et les codes de réponse rencontres. Une baisse soudaine du crawl indique un problème : serveur lent, erreurs, ou blocage accidentel dans le robots.txt.

Analysez vos logs serveur pour voir exactement quelles pages Googlebot visite, dans quel ordre, et à quelle fréquence. Des outils comme Screaming Frog ou Oncrawl facilitent cette analyse. Si vous constatez que des pages importantes ne sont jamais visitées, renforcez leur maillage interne et ajoutez-les au sitemap.

Questions fréquentes

Le crawl budget concerne-t-il les petits sites ?

Pour les sites de moins de 1 000 pages avec un bon maillage interne, le crawl budget est rarement un problème. Google explore facilement l’ensemble. C’est à partir de plusieurs milliers de pages que l’optimisation devient nécessaire.

Comment savoir si Google explore toutes mes pages ?

Consultez le rapport de couverture dans Google Search Console. Il indique le nombre de pages découvertes, indexées, et exclues. Comparez avec le nombre de pages dans votre sitemap pour identifier les écarts.

Bloquer des pages dans robots.txt ameliore-t-il le crawl budget ?

Oui, en empêchant Googlebot d’explorer des pages inutiles, vous liberez du budget pour les pages importantes. Mais attention à ne pas bloquer par erreur des pages où des ressources nécessaires au rendu de votre contenu.

Karim B.

Fondateur de Rankit · Agence SEO Lyon

Passionné par les données et le référencement depuis plus de 5 ans, j’accompagne les entreprises locales et e-commerce dans leur croissance organique. Mon approche : zéro bullshit, que du mesurable. Chaque stratégie que je déploie est pilotée par la Search Console, testée sur le terrain et optimisée pour des résultats concrets.